33_深度学习之外的人工智能__一图胜千言:概率图模型

文章目录

在前面两个模块中,我和你分享了神经网络和深度学习的知识。神经网络是理解深度表征的模型,深度学习是训练深度神经网络的算法,两者是一脉相承的关系。本质上讲,神经网络和深度学习都是由数据驱动的,大量有标记的训练样本是复杂模型取得良好性能的前提,这也解释了为什么直到近年来深度学习才得以蓬勃发展。

但深度学习远非实现人工智能的唯一途径,在接下来的四篇文章中,就让我和你聊一聊深度学习之外的人工智能。

早年间的人工智能赖以实现的基础是逻辑学,但逻辑学适用的是理想化的,不存在任何不确定性的世界。可遗憾的是,真实世界是由随机性和误差主宰的,在这光怪陆离的环境中,纯粹的数理逻辑就如同古板的老夫子一般与周遭格格不入。

可即使抛开噪声与干扰不论,很多问题也没有固定的解。在医学上,即使子女的基因和母亲的基因已经确定,父亲的基因也可以有多种可能。要解决这类不确定性推理的问题,就必须借助概率论的方法。而将概率方法与图论结合起来,得到的就是今天的主题:概率图模型。

概率图模型(probabilistic graphical model)也叫结构化概率模型,是用图论表现随机变量之间的条件依赖关系的建模方法。典型的概率图模型包括贝叶斯网络和马尔可夫随机场,分别对应着有向图模型和无向图模型。

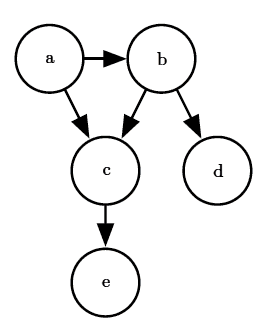

贝叶斯网络(Bayesian network)的拓扑结构是有向无环图,“有向”指的是连接不同顶点的边是有方向的,起点和终点不能调换;“无环”指的是从任意顶点出发都无法经过若干条边回到该点,在图中找不到任何环路。

贝叶斯网络中的顶点表示随机变量,一个顶点既可以表示可观察的显式变量,也可以表示未知参数和隐变量。如果不同的变量之间存在因果关系,那么相应的顶点就会由带箭头的边连接起来,箭头的方向由表示原因的变量指向表示结果的变量,边的权重就是对应的条件概率值。

图片引自《深度学习》图 3.7

图片引自《深度学习》图 3.7

贝叶斯网络的作用是表示出随机变量之间的条件依赖关系,将多个随机变量的联合概率分布分解为条件概率因子乘积的形式。

根据条件概率的链式法则,四个随机变量 A,B,C,DA,B,C,D

文章作者

上次更新 2025-01-03